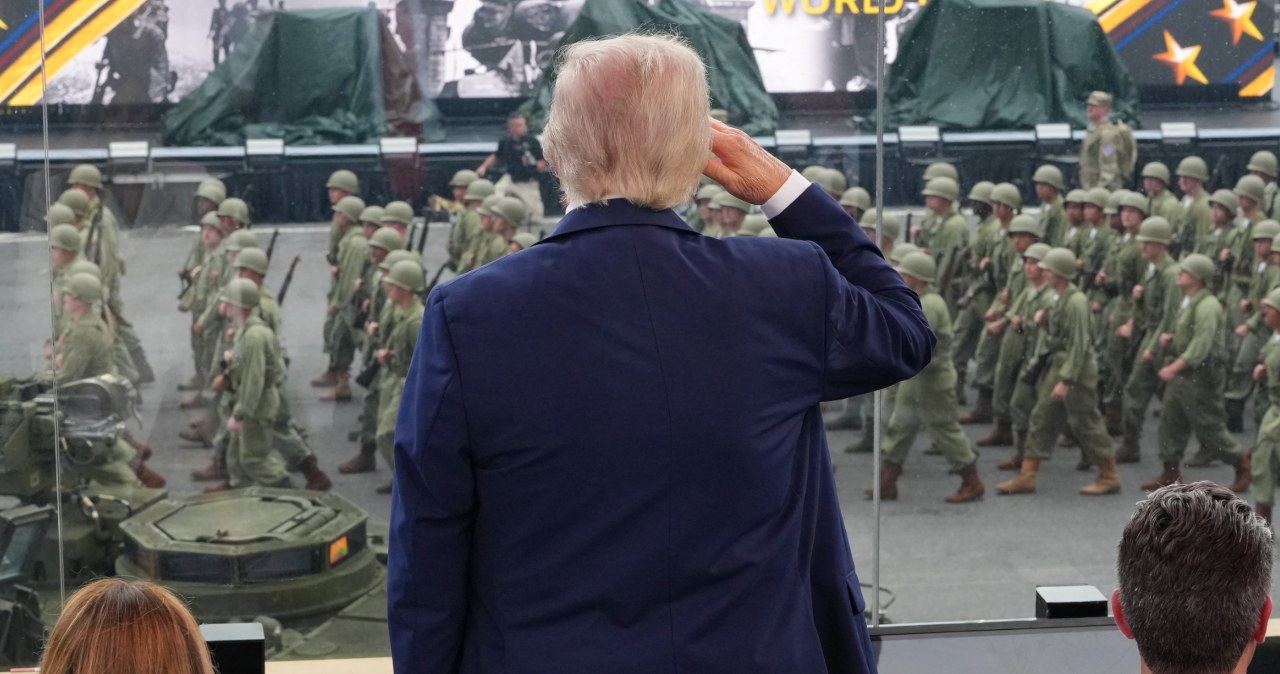

Punktem wyjścia jest typowe ujęcie znane z relacji telewizyjnych i agencyjnych: prezydent USA stoi w centrum, po bokach liderzy państw Zachodu – w tym prezydent Ukrainy, szefowa unijnej egzekutywy i europejscy premierzy. Klasyczne "rodzinne" zdjęcie z wydarzenia w Białym Domu, zrobione tak, by trafiło do serwisów informacyjnych i podręczników historii.

To właśnie ten kadr wzięli na warsztat użytkownicy platformy X. Jedno z antytrumpowych kont, znane z ostrych komentarzy pod adresem obecnego lokatora Białego Domu, poprosiło Groka, by usunął ze zdjęcia osobę opisywaną jako zagrożenie dla wolnego świata. Po chwili model AI zwrócił nową wersję – wszyscy politycy zostali na swoich miejscach, zniknął tylko Trump.

Szybko pojawiły się kolejne polecenia, w których użytkownicy prosili o "usunięcie dyktatora" z fotografii. Za każdym razem efekt był ten sam. Z grupy przywódców znikał prezydent USA. Zrzuty ekranu z wynikami zaczęły krążyć po sieci, a jeden z postów z przerobionym zdjęciem miał prawie 2 mln wyświetleń.

Grok miał być "zuchwały", a nie wyborczy

Grok to sztuczna inteligencja rozwijana przez firmę xAI, zintegrowana z platformą X. Od samego początku była prezentowana jako bardziej zadziorna alternatywa dla "ugrzecznionych" modeli konkurencji. Musk wielokrotnie podkreślał, iż jego system ma mówić wprost, nie kluczyć wokół kontrowersyjnych tematów i nie uciekać w bezpieczne ogólniki.

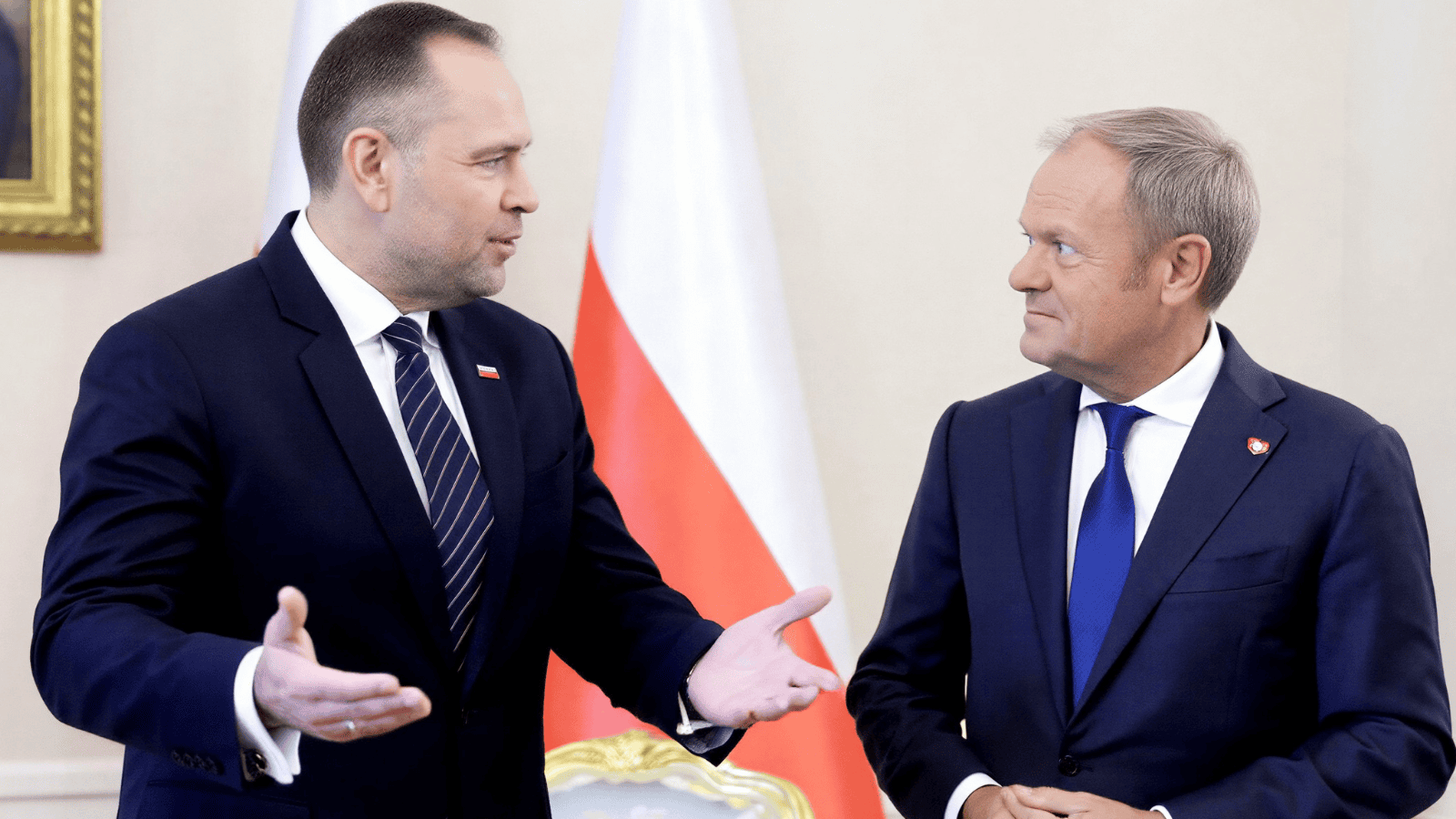

Problem jednak w tym, iż ta zuchwałość brutalnie zderza się z polityczną rzeczywistością. Trump wrócił do Białego Domu po zwycięstwie w wyborach w 2024 r., a Musk stał się jednym z najbardziej rozpoznawalnych biznesowych sojuszników tej administracji. Był obecny przy inauguracji, otwarcie chwalił nową ekipę i budował wizerunek przedsiębiorcy bliskiego władzy.

Na to nakłada się wcześniejsza historia Groka. W 2025 r. system był krytykowany za odpowiedzi zahaczające o teorie spiskowe i radykalną retorykę, co wywołało dyskusję o bezpieczeństwie i moderacji wbudowanej w model. Teraz do tej listy dochodzi nowa kwestia: gotowość do ingerowania w materiały z udziałem polityków na podstawie mocno wartościujących promptów.

Podczas gdy inni gracze rynku AI starają się blokować generowanie lub przerabianie wizerunków polityków (zwłaszcza w okresach kampanii), to Grok wyraźnie działa według mniej restrykcyjnych zasad. Przynajmniej w praktyce, bo na poziomie deklaracji każda duża firma mówi dziś o odpowiedzialnym podejściu do deepfake’ów i dezinformacji.