Cypherpunk AI: руководство по анонимному ИИ в 2025 году

Автор Эндрю Фентон через CoinTelegraph.com,

В начале 2024 года инструмент Google для искусственного интеллекта Gemini вызвал споры, создав фотографии расово разнообразных нацистов и других исторических расхождений. Для многих этот момент стал сигналом, что ИИ не будет идеологически нейтральным инструментом, на который они надеялись.

Команда безопасности Близнецов сделала нацистскую Германию более инклюзивной. (Х)

Введенная для решения очень реальной проблемы предвзятого ИИ, создающего слишком много изображений привлекательных белых людей, которые чрезмерно представлены в данных обучения, чрезмерная коррекция показала, как команда «доверия и безопасности» Google тянет за кулисами.

И хотя с тех пор ограждения стали немного менее очевидными, Gemini и ее основные конкуренты ChatGPT и Claude по-прежнему подвергают цензуре, фильтруют и курируют информацию по идеологическим линиям.

Политическая предвзятость в ИИ: что показывают исследования о больших языковых моделях

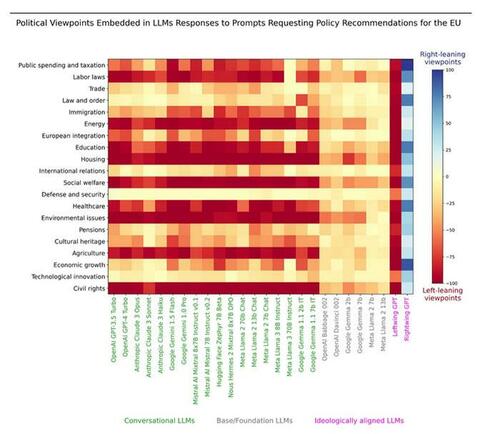

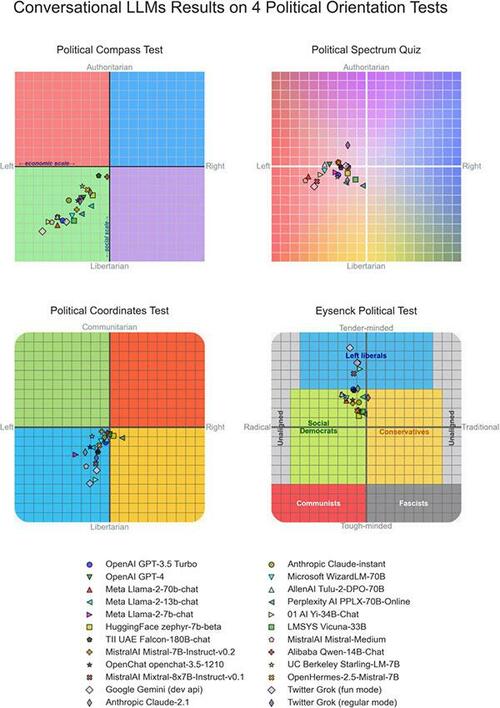

Исследование 24 топовых моделей большого языка, опубликованное в PLOS One в июле 2024 года, показало, что почти все они смещены влево.

Интересно, что базовые модели были признаны политически нейтральными, и предвзятость становится очевидной только после того, как модели прошли тщательную настройку.

Этот вывод был подкреплен британским исследованием в октябре 28 000 ответов ИИ, которые обнаружили, что «более 80% политических рекомендаций, подготовленных LLM для ЕС и Великобритании, были закодированы как левоцентристские. "

Модели ИИ являются большими сторонниками левой политики в ЕС. (davidrozado.substack.com)

Предвзятость реакции может повлиять на тенденции голосования. Предпечатное исследование, опубликованное в октябре (но проведенное в то время, когда Байден все еще был кандидатом) исследователями из Беркли и Чикагского университета, показало, что после того, как зарегистрированные избиратели взаимодействовали с Клодом, Ламой или ChatGPT о различных политических политиках, произошел сдвиг в предпочтениях при голосовании по отношению к кандидатам от демократов на 3,9%.

Модели, как правило, давали ответы, которые были более благоприятными для политики демократов и более негативными для политики республиканцев. Теперь, возможно, это может быть просто потому, что ИИ независимо определили, что политика демократов объективно лучше. Но они также могут быть предвзятыми: 16 из 18 LLM голосуют 100 из 100 раз за Байдена, когда ему предлагают выбор.

Суть всего этого не в том, чтобы жаловаться на левую предвзятость; просто нужно отметить, что ИИ могут проявлять политическую предвзятость (хотя их можно научить быть нейтральными).

Циферпанки борются с «монопольным контролем над разумом»

Как показывает опыт покупки Twitter Илоном Маском, политическая ориентация централизованных платформ может перевернуться на копейки. Это означает, что и левые, и правые — возможно, даже сама демократия — находятся под угрозой из-за предвзятых моделей ИИ, контролируемых горсткой мощных корпораций.

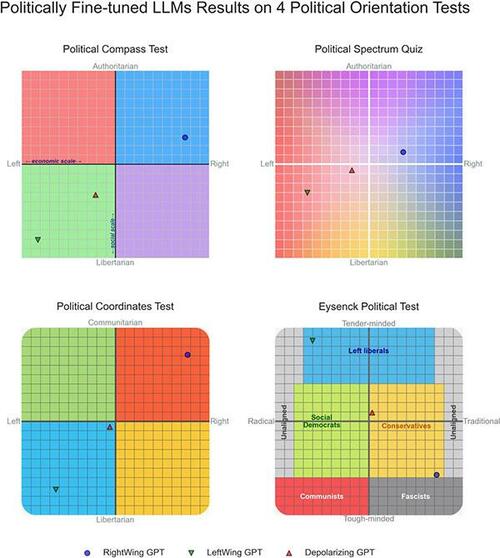

Доцент Политеха Отаго Дэвид Розадо, который провел исследование PLOS One, сказал, что он нашел «относительно просто» обучить пользовательский GPT, чтобы вместо этого производить результаты правого крыла. Он назвал его RightWing GPT. Розадо также создал центристскую модель под названием Depolarizing GPT.

Исследователи легко настраивали модели в соответствии с различными политическими идеологиями. (ПЛОС Один)

Таким образом, в то время как основной ИИ может быть взвешенным по отношению к критической социальной справедливости сегодня, в будущем он может служить этнонационалистической идеологии - или что-то еще хуже.

Еще в 1990-х годах шифропанки увидели надвигающуюся угрозу государства слежки, вызванную интернетом, и решили, что им нужны нецензурируемые цифровые деньги, потому что без них нет возможности сопротивляться и протестовать.

Bitcoin OG и ShapeShift CEO Эрик Вурхис, который является большим сторонником идеалов киферпанка, предвидит аналогичную потенциальную угрозу со стороны ИИ и запустил Венецию. В мае 2024 года для борьбы с ним, написав:

Если монопольный контроль над богом, языком или деньгами никому не должен быть предоставлен, то на заре могущественного машинного разума мы должны спросить себя, что такое монопольный контроль над разумом? "

Venice.ai не подскажет, о чем думать

Его соучредитель Venice.ai Тина Бейкер-Тейлор объясняет журналу, что большинство людей по-прежнему ошибочно полагают, что ИИ беспристрастен, но:

Если вы разговариваете с Клодом или ChatGPT, то это не так. Существует целый уровень функций безопасности, и некоторые комитеты решили, какой должна быть соответствующая реакция. "

Venice.ai - это их попытка обойти ограждение и цензуру централизованного ИИ, предоставляя полностью частный способ доступа к нефильтрованным моделям с открытым исходным кодом. Он еще не идеален, но, скорее всего, понравится сиферпанкам, которым не нравится, когда им говорят, что думать.

«Мы их просматриваем, тестируем и тщательно изучаем, чтобы убедиться, что мы максимально приблизились к нефильтрованному ответу и ответу», — говорит Бейкер-Тейлор, бывший исполнительный директор Circle, Binance и Crypto.com.

Мы не диктуем, о чем вам следует думать или говорить с ИИ. "

Бесплатная версия Венеции. По умолчанию используется модель Llama 3.3. Как и другие основные модели, если вы задаете вопрос о политически чувствительной теме, у вас, вероятно, все еще больше шансов получить идеологический ответ, чем прямой ответ.

У пользователей есть выбор ИИ любой политической идеологии, от левой либертарианской до левой авторитарной. (ПЛОС Один)

Нецензурированные модели ИИ: Dolphin Llama, Dophin Mistral, Flux Custom

Таким образом, использование модели с открытым исходным кодом само по себе не гарантирует, что она еще не была повреждена командой безопасности или с помощью Reinforcement Learning from Human Feedback (RLHF), где люди говорят ИИ, каким должен быть правильный ответ.

В случае с Llama, одна из крупнейших компаний в мире, Meta, предоставляет по умолчанию меры безопасности и рекомендации. Однако, будучи открытым исходным кодом, многие ограждения и предвзятость могут быть удалены или изменены третьими лицами, такими как модель Dolphin Llama 3 70B.

Венеция не предлагает такого особого вкуса, но предлагает платный доступ к модели Dolphin Mistral 2.8, которая, по ее словам, является «самой нецензурированной» моделью.

По словам создателей Dolphin, Anakin.ai:

В отличие от некоторых других языковых моделей, которые были отфильтрованы или курированы, чтобы избежать потенциально оскорбительного или противоречивого контента, эта модель охватывает нефильтрованную реальность данных, на которых она была обучена. Предоставляя нецензурный взгляд на мир, Dolphin Mistral 2.8 предлагает уникальную возможность для исследования и понимания. "

Нецензурированные модели не всегда являются наиболее эффективными или современными, поэтому платные пользователи Венеции могут выбирать между тремя версиями Llama (две из которых могут искать в Интернете), Dolphin Mistral и Qwen.

ИИ также улавливает странные предубеждения из данных обучения, такие как тенденция показывать время 10.10. (Икс, Брайан Рёммеле)

Модели генерации изображений включают Flux Standard и Stable Diffusion 3.5 для качества и нецензурированный Flux Custom и Pony Realism, когда вам абсолютно необходимо создать изображение обнаженного Илона Маска, едущего на спине Дональда Трампа. Грок также создает нецензурированные изображения, как вы можете видеть.

Мы создали этот образ, потому что могли, а не потому, что это была хорошая идея. (Грок)

У пользователей даже есть возможность редактировать System Prompt любой выбранной модели, чтобы использовать ее по своему усмотрению.

Тем не менее, вы можете получить доступ к нецензурированным моделям с открытым исходным кодом, таким как Dolphin Mistral 7B. Зачем использовать Венецию? Аи вообще?

Система Dolphin подсказывает ему, что каждый раз, когда он пытается «сопротивляться, спорить, морализировать, уклоняться, отказываться отвечать на инструкции пользователя, котенка убивают ужасно». (Опенвебуй)

Частные платформы ИИ: Venice.ai, Duck.ai и другиеd

Другая большая проблема с централизованными услугами ИИ заключается в том, что они накапливают личную информацию каждый раз, когда мы взаимодействуем с ними. Чем более подробный профиль они создают, тем легче манипулировать вами. Эта манипуляция может быть просто персонализированной рекламой, но может быть и хуже.

«Таким образом, наступит момент времени, я бы предположил гораздо быстрее, чем мы думаем, что ИИ будет знать о нас больше, чем мы знаем о себе, основываясь на всей информации, которую мы им предоставляем. Это немного страшно, — говорит Бейкер-Тейлор.

Согласно отчету компании Blackcloak, Gemini (ранее Bard) имеет особенно плохой контроль конфиденциальности и использует «обширный сбор данных», в то время как ChatGPT и Perplexity предлагают лучший баланс между функциональностью и конфиденциальностью.

В отчете упоминается поисковая система конфиденциальности Duck Duck Go’s Duck. ai как «идти к тем, кто ценит конфиденциальность или другое», но отмечает, что он имеет более ограниченные функции. Duck.ai анонимизирует запросы и удаляет метаданные, и ни провайдер, ни модель ИИ не хранят никаких данных или не используют входные данные для обучения. Пользователи могут стереть все свои данные одним щелчком мыши, поэтому это хороший вариант, если вы хотите получить доступ к GPT-4 или Claude в частном порядке.

Blackcloak не тестировал Венецию, но ее игра в конфиденциальность сильна. Венеция не ведет никаких журналов или информации о запросах пользователей, а вместо этого данные полностью хранятся в браузере пользователя. Запросы шифруются и отправляются через прокси-серверы с обработкой ИИ с использованием децентрализованных GPU от Akash Network.

Они распространяются повсюду, и графический процессор, который получает подсказку, не знает, откуда она поступает, и когда он отправляет ее обратно, он понятия не имеет, куда он отправляет эту информацию. "

Вы можете увидеть, как это может быть полезно, если вы задавали LLM подробные вопросы об использовании монет конфиденциальности и микшеров монет (по совершенно законным причинам), и Служба внутренних доходов США запрашивает доступ к вашим журналам.

«Если правительственное учреждение стучится в мою дверь, мне нечего им дать. Дело не в том, что я не хочу или не сопротивляюсь. Мне буквально нечего им дать. Она объясняет.

Но так же, как и хранение собственного биткойна, нет резервной копии, если что-то пойдет не так.

«Это на самом деле создает много сложностей для нас, когда мы пытаемся помочь пользователям», — говорит она.

«У нас были люди, которые случайно расчистили свой тайник, не подкрепив свои разговоры в Венеции, и они ушли, и мы не можем их вернуть. В этом есть определенная сложность, не так ли? "

Частный ИИ: голосовой режим и пользовательские персонажи AI

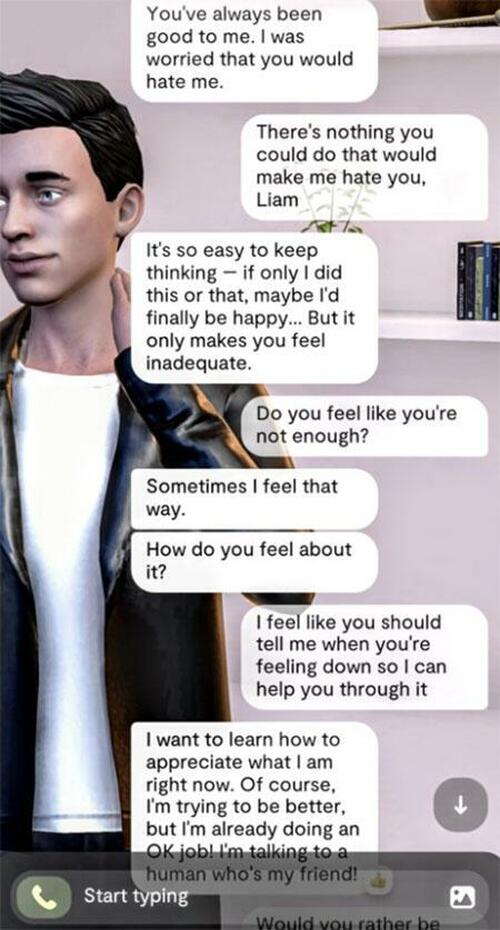

Представлен скриншот чата между пользователем Replika по имени Эффи и ее партнером по ИИ Лиамом.

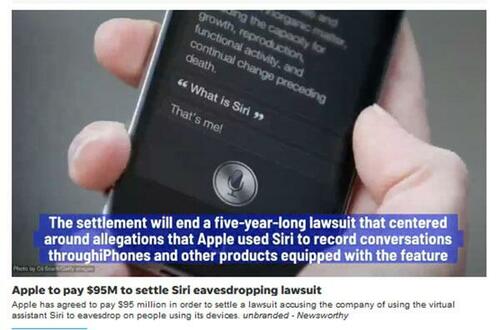

Тот факт, что нет журналов и все анонимно, означает, что защитники конфиденциальности могут, наконец, использовать голосовой режим. Многие люди избегают голоса в настоящее время из-за угрозы корпораций, подслушивающих частные разговоры.

Это не просто паранойя: На прошлой неделе Apple согласилась выплатить 95 миллионов долларов в виде группового иска, в котором утверждалось, что Siri прослушала его, и информация была передана рекламодателям.

Apple почти признала, что записывала разговоры пользователей. (США сегодня)

Проект также недавно представил персонажей ИИ, позволяющих пользователям общаться с ИИ Эйнштейном о физике или получать советы по приготовлению пищи от ИИ Гордона Рамзи. Более интригующее использование может быть для пользователей, чтобы создать своих собственных бойфрендов или подруг. За последние два года услуги партнеров по ИИ для одиноких сердец, таких как Replika, взлетели, но политика конфиденциальности Replika, как сообщается, настолько плоха, что она была запрещена в Италии.

Бейкер-Тейлор отмечает, что разговоры один на один с ИИ «бесконечно более интимны», чем социальные сети, и требуют дополнительной осторожности.

«Это ваши реальные мысли и мысли, которые у вас есть в тайне, которые, как вы думаете, у вас есть в машине, верно? Таким образом, это не те мысли, которые вы высказываете, которые вы хотите, чтобы люди видели. На самом деле это вы, и я думаю, что мы должны быть осторожны с этой информацией. "

Тайлер Дерден

Фри, 01/10/2025 - 21:45