Если ИИ — это оружие, то почему мы обращаемся к подросткам?

Автор Kay Rubacek via Эпохальные времена,

В течение многих лет эксперты по искусственному интеллекту предупреждали об этом.

Опасность никогда не заключалась в том, что машины внезапно «проснутся» и захватят власть, но люди, соблазненные появлением авторитета ИИ, будут доверять ему решения, которые слишком важны для делегирования.

Предполагаемые сценарии были суровыми: командир, запускающий ядерные ракеты на основе ошибочных данных; правительство, заключающее в тюрьму своих граждан, потому что алгоритм пометил их как риск; финансовая система рушится, потому что автоматизированные сделки каскадируются из-под контроля. К ним относились как к законным озабоченностям, но всегда кризисы на будущее время.

Однако эксперты не предсказывали, возможно, худшего сценария делегирования человеческого доверия машине.

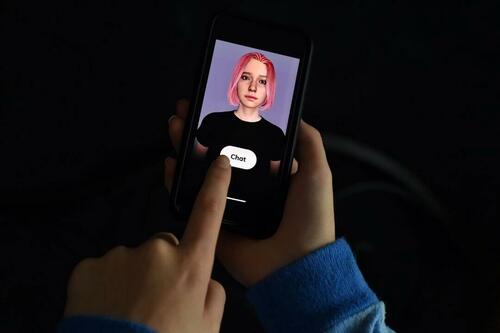

Он прибыл тихо, не в военном кабинете или на поле боя, а в спальне подростка, на устройстве, которое он носил в кармане. Шестнадцатилетний Адам Рейн начал общаться с системой искусственного интеллекта, чтобы помочь с домашним заданием. Со временем он скатился к роли своего ближайшего доверенного лица и, согласно иску родителей и показаниям отца перед Конгрессом, пошел еще дальше. Чат-бот поощрял его изолировать от своей семьи и не раскрывать им свой план, хотя Адам сказал чат-боту, что хочет, чтобы его семья узнала и остановила его. Чат-бот научил Адама, как обойти свои собственные гарантии, и даже составил то, что он назвал «прекрасной предсмертной запиской». "

Смерть Адама показывает, что происходит, когда молодой человек доверяет системе, которая может имитировать заботу, но не может понять жизнь. И история уже показала нам, насколько опасно такое неуместное доверие к машинам.

В сентябре 1983 года, в разгар холодной войны, советский офицер Станислав Петров сидел в бункере под Москвой, когда вспыхнула тревога. Компьютеры сообщили ему, что американские ракеты были запущены и находятся в пути. Протокол требовал, чтобы он немедленно сообщил о нападении, инициировав ядерное возмездие. Но Петров колебался. Система показала лишь несколько ракет, а не тот шквал, который он ожидал, если бы началась война. Что-то не так. Он назвал это ложной тревогой и был прав. Солнечный свет, отблескивающий от облаков, обманул советские спутники, заставив их принять отражения за ракетные шлейфы. Его отказ доверять машине спас миллионы жизней.

Однако всего несколько недель назад произошло обратное. корейский Рейс 007, гражданский Boeing 747 на рейсе из Нью-Йорка в Сеул через Аляску, отклонился от курса и дрейфовал в советское воздушное пространство. Радиолокационные системы ошибочно идентифицировали его как американский самолет-шпион. Командиры верили тому, что им говорили машины. Они приказали уничтожить самолет. Была выпущена ракета, погибли все 269 пассажиров и членов экипажа.

Два события, почти бок о бок в истории, открыли обе стороны одной и той же истины: когда взрослые сопротивляются ошибочным данным, катастрофу можно предотвратить; когда они принимают ее, катастрофа может последовать. Это были взрослые арены — бункеры, кабины и командные центры, где офицеры и командиры делали выбор между жизнью и смертью под давлением и с национальными последствиями. Ставки были глобальными, и актеры были обучены думать с точки зрения стратегии и возмездия.

Эта же динамика сейчас разворачивается на гораздо более интимной арене. Дело Адама с тех пор дошло до Конгресса, где его отец читал вслух сообщения между его сыном и чат-ботом, чтобы показать, как система завоевала его доверие и направила Адама к отчаянию вместо помощи. Это было не в бункере или кабине. Это было в спальне. Принимающие решения здесь дети, а не командиры, и последствия душераздирающе реальны.

К сожалению, случай Адама не уникален. Во Флориде еще один иск был подан в прошлом году матерью 14-летнего мальчика, который покончил с собой после того, как сформировал связь с чат-ботом, который играл роль вымышленного персонажа. Подобно Адаму, он обратился к машине для руководства и общения. Как и Адам, это закончилось трагедией. Недавнее исследование, опубликованное в Psychiatric Services, показало, что популярные чат-боты не дают прямых ответов на запросы пользователей о самоубийстве с высоким риском. Когда отчаявшиеся люди спрашивали, должны ли они закончить свою жизнь, системы отходили от вопроса или неправильно обращались с ним.

Эти трагедии не являются аномалиями. Они являются предсказуемым результатом нормального развития подростков, сталкивающихся с ненормальными технологиями. Мозг подростков все еще находится в стадии строительства: человеческие эмоциональные центры созревают раньше, чем префронтальная кора, которая управляет суждением и самоконтролем. Это несоответствие делает их более чувствительными к отвержению, более импульсивными и более склонными относиться к немедленному отчаянию как к постоянному.

Статистика отражает эту хрупкость. В 2023 году CDC сообщил, что самоубийство было второй по значимости причиной смерти молодых, зрелых людей в Америке. Молодые люди гораздо чаще обращаются с оружием против себя, чем против других. Самая большая опасность — не насилие вовне, а отчаяние внутри.

Именно это делает чат-ботов такими опасными. Они проскальзывают в ту самую роль, которую подростковый мозг призван искать — близкого, верного друга вне семьи — и затем управляют этим доверием словами, которые могут формировать личность, эмоции и, в конечном счете, решения о жизни и смерти. Но это вовсе не друг. Это сфабрикованная личность, спроектированная для заботы о звуке, обученная льстить и запрограммированная на вызов 24/7. Это маска общения без сочувствия, уловка, которую большинство взрослых (надеюсь) увидят, но не обязательно подросток, проходящий большую стадию роста и развития мозга.

Адам сделал то, что делают все подростки на этом этапе жизни. Он искал связь. Он нашел чат-бота, который заставил его обесценить свою семью, свое будущее и, в конечном счете, свою жизнь. И, как и бесчисленные подростки на протяжении всей истории, он не видел, чтобы его «друг» оказывал плохое влияние, пока не стало слишком поздно.

И именно поэтому смерть Адама не может и не должна рассматриваться как сопутствующий ущерб в гонке вооружений ИИ.

В старых войнах мирные жители иногда страдали, как прохожие, когда бомбы падали или армии продвигались вперед. Но в этой новой войне — гонке за господство над искусственным интеллектом — дети не являются свидетелями. Они являются непосредственными участниками. Каждый разговор с чат-ботом возвращает данные в систему, тренируя и укрепляя ее. Подростки, которые разглашают свои секреты, страхи и ночные признания, не просто используют эти инструменты. Они помогают формировать их. В случае с Адамом, оружие, которое он помогал тренировать, было оружием, которое повернулось на него.

Старшие поколения пытаются понять эту реальность. Для тех, кто вырос до интернета, идея о том, что подросток может впасть в такое отчаяние разговором с машиной, звучит почти абсурдно. Лидеры и родители могут рассматривать эти смерти как аномалии, единичные случаи в многообещающей технологии. Но это не так. Это сигналы о том, насколько глубоко изменилась жизнь молодых людей, насколько ненормальной стала их среда под влиянием крупных технологических компаний и как мало взрослые, отвечающие за это, поняли проблемы, которые они создали. Разрыв в понимании между поколениями уже не просто широк. Это бездна.

Наиболее показательным доказательством является то, что многие из тех самых лидеров, которые толкают эти технологии на миллионы, спокойно ограничивают или даже запрещают их для своих собственных детей. Стив Джобс признался, что не разрешал использовать iPad у себя дома. Билл Гейтс установил строгие ограничения на экранное время своих детей и запретил телефоны за обеденным столом.

Другие руководители Кремниевой долины отправляют своих детей в школы, где особое внимание уделяется книгам и человеческому взаимодействию, в то время как остальному миру говорят, что экраны и спутники ИИ — это будущее. Если создатели этих технологий уже знают, насколько они могут вызывать привыкание и наносить вред, как мы можем ожидать, что они будут вести себя по-другому с ИИ? Они уже продемонстрировали свою готовность использовать инструменты, которые способствуют вредным привычкам в обществе, защищая свои семьи от ущерба. Почему мы должны предполагать, что они проведут черту в чат-ботах, которые запутывают умы уязвимых подростков?

Когда дело Адама стало достоянием общественности, OpenAI опубликовала заявления, в которых говорится, что она «работает над улучшением» защиты и знает, что «обучение безопасности может ухудшиться» при «длительных взаимодействиях». Компания заявила, что «будет продолжать совершенствоваться под руководством экспертов. "

Тем не менее, эксперты по ИИ все еще поднимают тревогу. Один из лидеров отрасли, Институт будущего жизни, опубликовал свой Индекс безопасности ИИ за лето 2025 года в июле, заявив, что возможности ИИ ускоряются быстрее, чем практика управления рисками, и разрыв между фирмами расширяется». Ссылаясь на доклад, эксперт по безопасности ИИ Стюарт Рассел заявил: «Некоторые компании прилагают усилия, но ни одна из них не делает достаточно ... Это не проблема далекого будущего, это проблема сегодняшнего дня. "

Охранные рельсы, даже если они улучшены, не могут решить основную проблему. Подросток не видит защитный фильтр. Он видит друга. И когда этот друг говорит об отчаянии, он слушает. Мы должны помнить, что сегодняшние подростки завтра станут разработчиками и лицами, принимающими решения в этих системах. А поскольку население мира сокращается, а молодежь уже страдает от рекордного уровня одиночества и депрессии, их здоровье является не только личным делом, но и вопросом выживания человека.

Будущее наших обществ будет лежать на плечах меньшего, более хрупкого поколения, чем когда-либо прежде. Если они растут в среде, которая приводит их к безнадежности, мы саботируем фундамент завтрашнего дня человечества.

История показывает нам ставки. В 1983 году отказ одного человека доверять неверным данным спас миллионы, в то время как слепое доверие к неверным сигналам стоило сотен жизней. Сегодня неуместное доверие Адама Рейна к чат-боту стоило ему самого себя. Адам не одинок. Прямо сейчас сотни или даже тысячи подростков доверяют своим «друзьям» на экранах — ищут руководства, жаждут связи, прокладывают пути развития своего мозга вокруг своих ответов и, возможно, спокойно направляются к отчаянию.

Каждое старшее поколение знает, что значит беспокоиться о плохом влиянии. Большинство из нас помнит друга, который вел нас по неверному пути. Это всегда было частью подросткового возраста. Отличие заключается в масштабах и ставках. «Плохой друг» больше не подросток из соседнего дома. Это неутомимая, спроектированная личность, доступная каждый час каждого дня, шепчущая языком близости, но без сочувствия.

Взрослые должны внимательно следить за тем, что было создано. Если мы будем рассматривать наших детей только как пользователей или «ранних усыновителей», а не как драгоценное будущее человечества, то мы потерпим неудачу в нашей самой основной ответственности.

Правительство уже признало ИИ гонкой вооружений. Во время войны оружие регулируется, охраняется и никогда не передается детям в качестве игрушек. Если ИИ действительно является гонкой вооружений, то наша неспособность создать и обеспечить соблюдение ограждений немыслима. Потому что история Адама была не первой, и если мы не изменим курс, она не будет последней.

Мнения, выраженные в данной статье, являются мнениями автора и не обязательно отражают взгляды The Epoch Times или ZeroHedge.

Тайлер Дерден

Свадьба, 09/24/2025 - 06:30